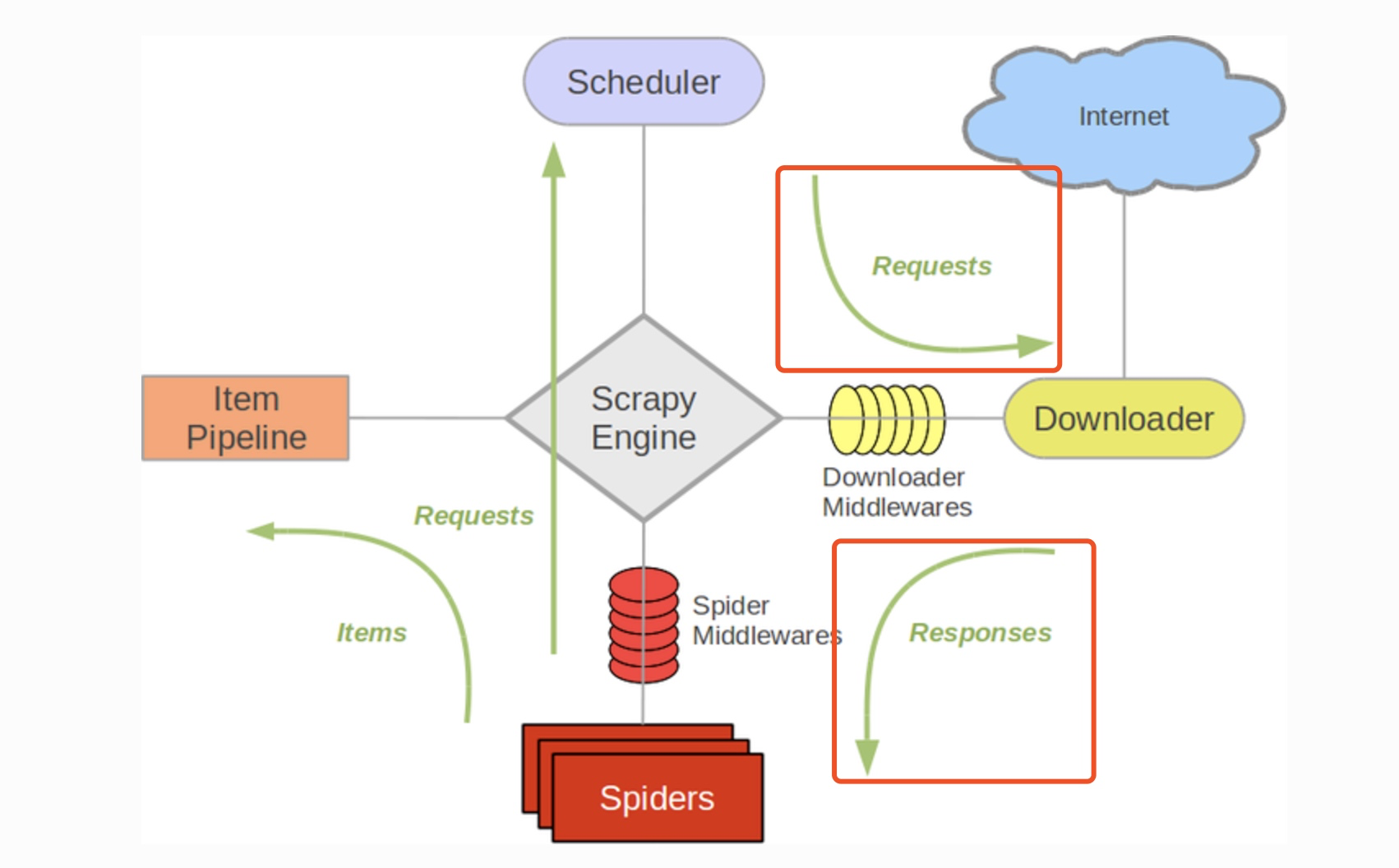

下载器中间件是介于Scrapy的request/response处理的钩子框架。 是用于全局修改Scrapy request和response的一个轻量、底层的系统。

Downloader Middleware处理的过程主要在调度器发送requests请求的时候以及网页将response结果返回给spiders的时候,所以从这里我们可以知道下载中间件是介于Scrapy的request/response处理的钩子,用于修改Scrapy request和response。

class Scrapy.downloadermiddleares.DownloaderMiddleware

process_request(request,spider)

当每个request通过下载中间件时,该方法被调用,这里有一个要求,该方法必须返回以下三种中的任意一种:None,返回一个Response对象,返回一个Request对象或raise IgnoreRequest。三种返回值的作用是不同的。

None:Scrapy将继续处理该request,执行其他的中间件的相应方法,直到合适的下载器处理函数(download handler)被调用,该request被执行(其response被下载)。

Response对象:Scrapy将不会调用其他低优先级的process_request()或process_exception() 方法;其将返回该response,每个Download Middleware 的process_response() 方法被依次调用,调用完毕后,直接将Response对象发送给Spider处理。

Request对象:Scrapy则停止调用其他低优先级的 process_request方法,这个Request回重新放到调度队列里,其实它就是一个新Request。当新返回的request被执行后, 相应地中间件process_request()将会被重新按照顺序调用。

raise一个IgnoreRequest异常:则安装的下载中间件的 process_exception() 方法会被调用。如果没有任何一个方法处理该异常, 则request的errback(Request.errback)方法会被调用。如果没有代码处理抛出的异常, 则该异常被忽略且不记录。

process_response(request, response, spider)

process_response的返回值也是有三种:response对象,request对象,或者raise一个IgnoreRequest异常

Response:更低优先级的Downloader Middleware 的process_response()方法会继续调用,继续对该Response 对象进行处理。

Request 对象:更低优先级的Downloader Middleware 的process_response()也不再被继续调用,该Request 对象会重新放到调度队列里面等待被调度,它相当于一个全新的 Request 。然后,该Request 又会被process_request()方法顺次处理。

raise一个 IgnoreRequest 异常:则调用request的errback(Request.errback)。 如果没有代码处理抛出的异常,则该异常被忽略且不记录(不同于其他异常那样)。

process_exception(request, exception, spider)

当下载处理器(download handler)或 process_request() (下载中间件)抛出异常(包括 IgnoreRequest 异常)时,Scrapy调用 process_exception()。

process_exception() 也是返回三者中的一个: 返回 None 、 一个 Response 对象、或者一个 Request 对象。

None:当返回为None 时,更低优先级的Downloader Middleware 的process_exception()会被继续顺次调用,直到所有的方法都被调度完毕。

Response 对象:更低优先级的Downloader Middleware 的process_exception()方法不再被继续调用,每个Downloader Middleware 的process_response()方法转而被依次调用。

Request 对象: 更低优先级的Downloader Middleware 的process_exception()也不再被继续调用,该Request 对象会重新放到调度队列里面等待被调度,它相当于一个全新的 Request 。然后,该Request 又会被process_request()方法顺次处理。

案例:

1、利用process_request(request,spider)在请求链接前修改代理地址:

class ProxyMiddleare(object):

logger = logging.getLogger(__name__)

def process_request(self,request, spider):

self.logger.debug("Using Proxy")

request.meta['proxy'] = 'http://127.0.0.1:9743'

return None

2、利用process_response(request, response, spider)修改状态码

class ReqponseMiddleare(object):

logger = logging.getLogger(__name__)

def process_response(self,request, spider):

self.logger.debug("modify response.status")

request.status = 201

return response

然后在spider中打印状态码:

class HtttpbinSpider(Spider):

name = 'httpbin'

allowed_domains = ['httpbin.org']

start_url = ['http://httpbin.org/get']

def parst(self, response):

print('状态码为:',reponse.status)

3、利用process_exception(request, exception, spider)请求出现报错后修改代理然后重新请求

首先请求google,请求无法成功,等待10s后重试

class GoogleSpider(Spider):

name = 'google'

allowed_domains = ['www.google.com']

start_url = ['http://www.google.xom']

def make_request_from_url(self, url):

return scrapy.Request(url=url,meta={'download_timeout':10},callback=self.parse)

def parse(self,reponse):

print(respoonse.text)

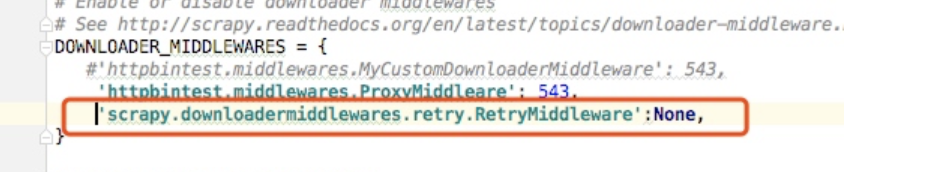

如果不想重试的话可以把重试中间件关掉,关掉后爬取出现异常报错

如果关掉重试中间件不想报错的话,将代理中间件的代理改成如下,表示遇到异常的时候给请求加上代理,并返回request,这个样就会重新请求谷歌

class ProxyMiddleare(object):

logger = logging.getLogger(__name__)

def process_expextion(self,request, exception,spider):

self.logger.info("GET Exception")

request.meta['proxy']='http://127.0.0.1:9743'

return request

4、设置cookies

一般设置

#cookie为一个字典类型数据

def process_request(self, request, spider):

request.cookies = cookies