Windows 端 Hdfs 客户端实现文件上传、下载等操作

文章目录

1. 先在 Centos 上开启 Hdfs

具体可参考:

2. 在 Windows 上配置 Hadoop

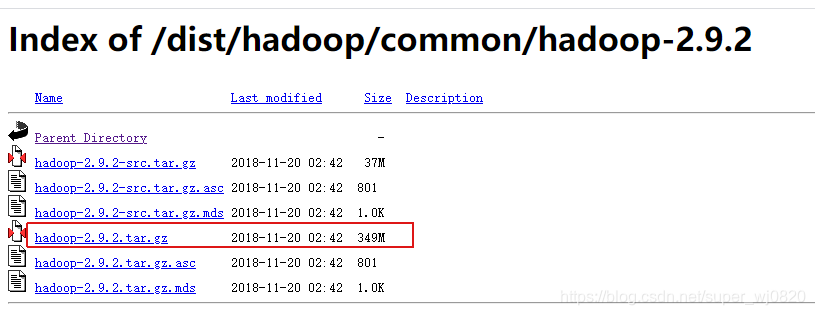

2.1 下载 Hadoop 包

地址:https://archive.apache.org/dist/hadoop/common/hadoop-2.9.2/

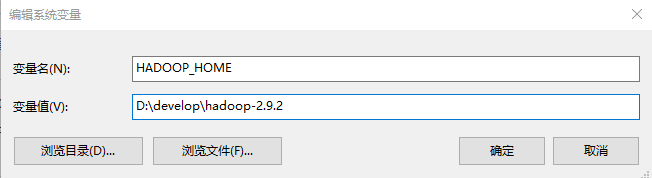

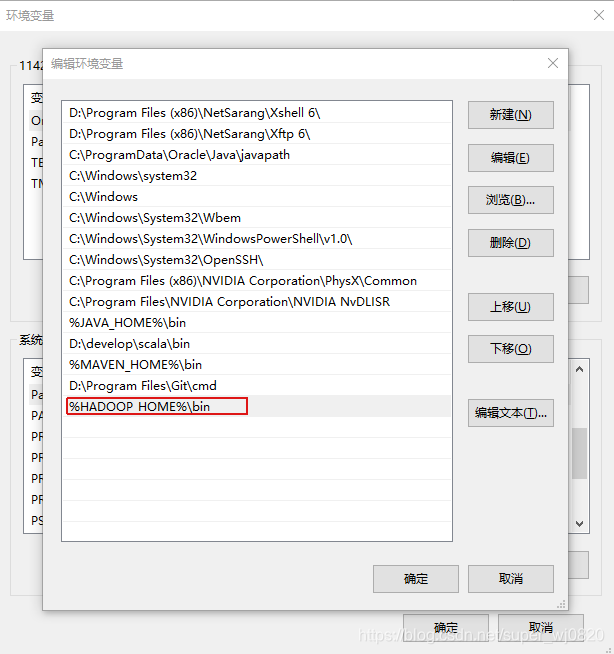

2.2 解压配置

解压到目录下,在高级系统设置中设置环境变量

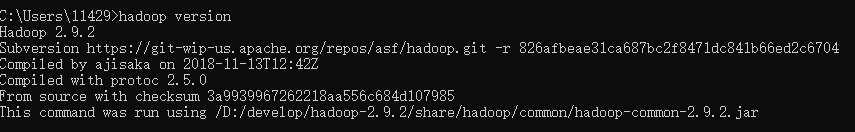

配置完成,在 cmd 输入"hadoop version"

验证成功

2.3 可能的错误

出现下面错误, 但是 java 却是正常的

Error: JAVA_HOME is incorrectly set. Please update …\hadoop\conf\hadoop-env.cmd

到 …\hadoop-2.9.2\etc\hadoop 路径下面找到文件 “hadoop-env”

点开配置 JAVA那行, 由于 JAVA 路径原有路径C盘下面的"program file" 有空格, 所以换成"\PROGRA~1", 再保存

参考:https://www.cnblogs.com/Jomini/p/11432484.html

3. 配置 winutil 和 hadoop.ddl

因为 Hadoop 主要基于 Linux 编写,这个 winutil.exe 主要用于模拟 Linux 下的目录环境

因此 Hadoop 放在 Windows 下运行的时候,需要这个辅助程序才能运行

3.1 下载 winutil 和 hadoop.ddl

3.2 拷问至 .\hadoop-2.9.2\etc\hadoop\bin 目录

4. 创建 maven 工程, 运行读写程序

4.1 pom 文件

<!--定义的标签属性可以在其他地方读取-->

<properties>

<hadoop.version>2.9.2</hadoop.version>

</properties>

<dependencies>

<dependency>

<groupId>org.apache.logging.log4j</groupId>

<artifactId>log4j-core</artifactId>

<version>2.8.2</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>${hadoop.version}</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>${hadoop.version}</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>${hadoop.version}</version>

</dependency>

</dependencies>

4.2 运行上传文件

package com.hadoop.wj;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.net.URI;

public class Apptest {

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(new URI("hdfs://master:9000"), conf, "root");

Path src = new Path("F:\\IdeaProjects\\bigData\\HdfsClient\\src\\main\\resources\\test.txt");

Path dest = new Path("/");

fs.copyFromLocalFile(src, dest);

FileStatus[] fileStatus = fs.listStatus(dest);

for (FileStatus file : fileStatus) {

System.out.println(file.getPath());

}

System.out.println("上传成功");

}

}

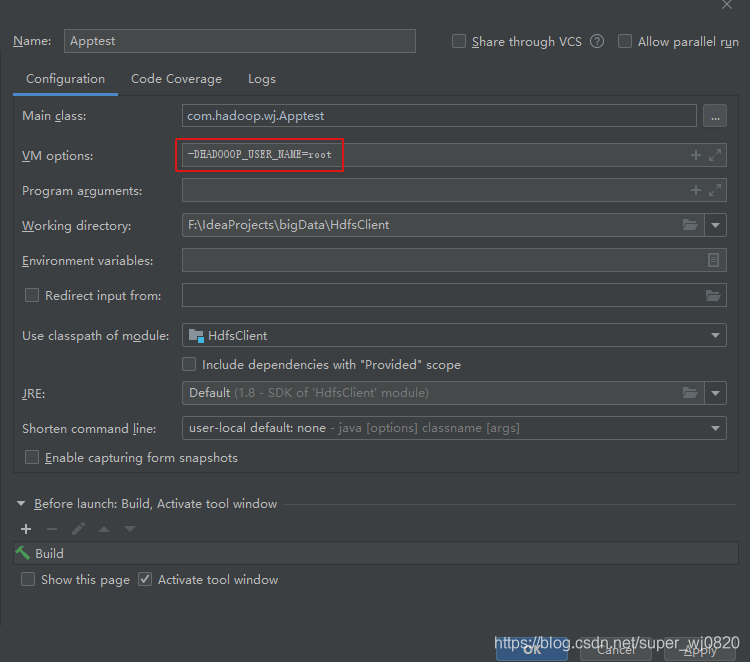

注意:代码中直接指定 Hdfs 用户为 root,如果不指定,需要在 VM Options 中指定 HADOOP_USER_NAME 为你 hdfs 集群的用户,如下:

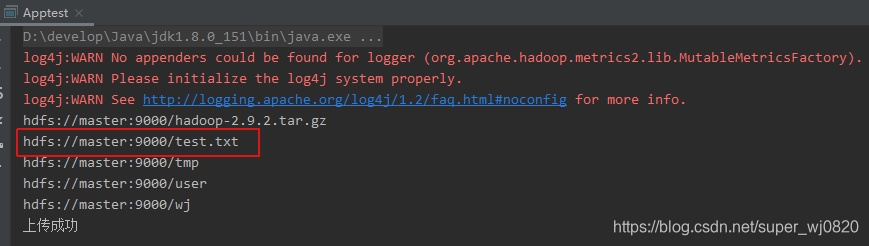

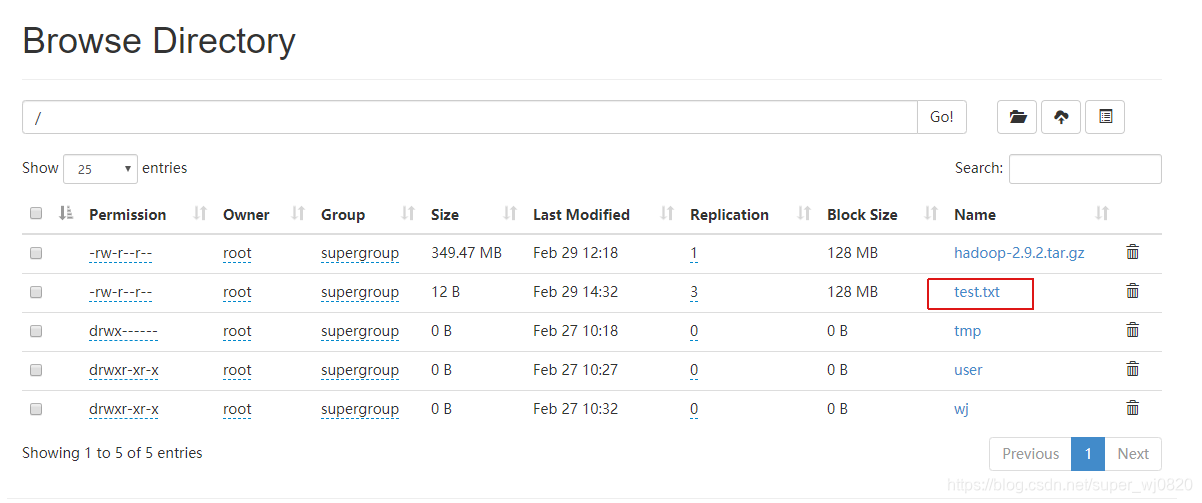

4.3 查看结果

文件上传成功!

来源:CSDN

作者:super_man_0820

链接:https://blog.csdn.net/super_wj0820/article/details/104575249